AIとクラウドコンピューティングの急速な進展により、私たちの生活は大きく変わりつつあります。しかし、その一方でプライバシーや公平性に関する新たな倫理的課題が浮上しています。

本記事では、これらの課題に対する最新の情報と具体的な対策について探ります。企業や政府の取り組みを紹介しながら、未来のAI技術が信頼されるための指針を考察します。

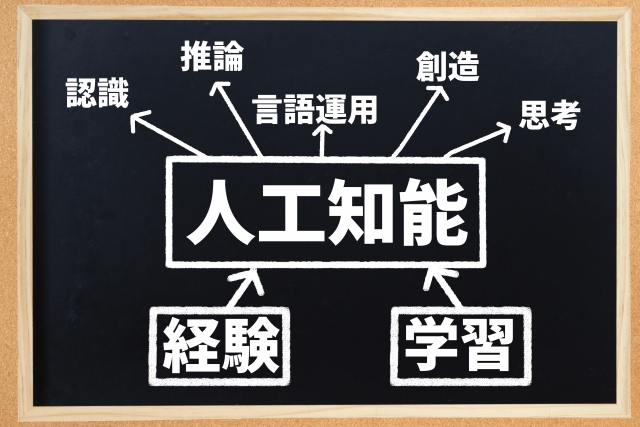

AI倫理とは何か?

AI倫理は、人工知能技術の開発と利用に関する道徳的な原則やガイドラインを指します。AI技術の急速な進歩に伴い、その利用における倫理的な側面がますます重要視されています。AIがもたらす影響は、プライバシーの侵害、意思決定の透明性、公平性の欠如など、多岐にわたります。

これらの問題は、特にビジネスや公共政策の分野で顕著です。AI倫理の主な目的は、技術が人々の生活を向上させる一方で、悪用や誤用を防ぐことです。企業はAIシステムの透明性を確保し、意思決定の過程を明示する必要があります。

また、データの収集と利用においても個人のプライバシーを保護する措置が求められます。公平性も重要な課題であり、AIアルゴリズムが偏見を持つことなく、公正な結果を提供することが求められます。これには、データの質の向上と多様性の確保が必要です。

さらに、AI倫理は技術の責任を明確にし、問題が発生した際の責任の所在を明らかにすることも含まれます。特に、医療や金融などの重要な分野では、AIシステムの誤動作が重大な影響を及ぼす可能性があるため、企業は倫理的なガイドラインに従うことが不可欠です。AI倫理は、技術の進化とともに継続的に見直されるべき動的な分野であり、企業や政府は常に最新の動向を把握し、適切な対策を講じることが求められます。

クラウドコンピューティングと倫理の交差点

クラウドコンピューティングは、企業が大規模なデータを効率的に管理・活用するための重要な技術です。しかし、この技術の利用には倫理的な課題が伴います。クラウド環境では、データの保存場所やアクセス権限が不明確になることが多く、これがプライバシー侵害のリスクを高めます。

企業はデータの保護と管理において高い透明性を維持する必要があります。クラウドサービスプロバイダーは、データの暗号化やアクセス制御を強化することで、セキュリティリスクを軽減することが求められます。

また、クラウド環境ではデータの所有権や責任の所在が曖昧になりがちです。これにより、データ漏洩や不正アクセスが発生した場合の対応が遅れる可能性があります。企業はクラウドサービスの選定において、信頼性と倫理的な対応を重視するべきです。

さらに、クラウドコンピューティングは多国籍企業によるデータの国際的な移動を容易にしますが、これにより各国の法律や規制との整合性が問われます。企業は各国の法規制を遵守し、データの取り扱いに関する倫理的なガイドラインを確立する必要があります。クラウド環境でのデータ管理は、技術的な側面だけでなく、倫理的な観点からも慎重に検討されるべきです。

これにより、企業は信頼性と透明性を確保し、顧客やパートナーからの信頼を維持することができます。クラウドコンピューティングの普及に伴い、これらの倫理的課題に対する対策はますます重要性を増しています。

プライバシー侵害のリスク

AIとクラウドコンピューティングの普及により、個人情報の大量収集と分析が可能になりましたが、これに伴いプライバシー侵害のリスクが高まっています。企業は、顧客データの取り扱いにおいて高い倫理基準を維持する必要があります。クラウド環境では、データの保存場所やアクセス権限が複雑化し、これが不正アクセスやデータ漏洩の原因となることがあります。

このため、企業はデータの暗号化やアクセス制御の強化を行い、プライバシー保護を徹底することが求められます。また、顧客に対してデータ利用の透明性を確保し、どのようにデータが収集・利用されるのかを明確に説明することも重要です。これにより、顧客の信頼を維持し、企業の信用を高めることができます。

さらに、AIアルゴリズムの開発においても、プライバシー保護を考慮した設計が求められます。特に、データの匿名化や個人識別情報の取り扱いには慎重な対応が必要です。企業は、法規制を遵守し、プライバシーに配慮したデータ処理プロセスを確立することで、リスクを最小限に抑えることができます。

プライバシー侵害のリスクは、技術の進化とともに変化し続けるため、企業は常に最新の情報を収集し、適切な対策を講じることが求められます。これにより、企業は顧客のデータを安全に保護し、信頼性の高いサービスを提供することができます。

意思決定の透明性の重要性

AIシステムの意思決定プロセスは、その複雑さからしばしば不透明になりがちです。企業は、AIの導入に際して、このプロセスの透明性を確保することが極めて重要です。透明性の欠如は、顧客やパートナーの信頼を損ねるだけでなく、法的なリスクをも引き起こす可能性があります。

意思決定の透明性を確保するためには、まずAIアルゴリズムの動作を明確に説明できるようにすることが必要です。これは、技術的な専門知識を持たないユーザーにも理解できる形で提供されるべきです。例えば、意思決定に影響を与える要因やプロセスを視覚的に示すことが有効です。

さらに、企業はAIシステムの検証と監査を定期的に行うことで、透明性を維持することが求められます。これにより、AIシステムの正確性と公平性を確保し、偏りや誤差を最小限に抑えることができます。特に、意思決定に重大な影響を与える分野では、透明性の確保は欠かせません。

また、企業は倫理委員会や第三者機関を活用して、AIシステムの運用における倫理的な監視を行うことも有効です。これにより、内部だけでなく外部の視点からも透明性を確保し、問題が発生した際には迅速に対応することが可能となります。

意思決定の透明性は、企業がAI技術を信頼性高く運用するための基盤です。これを徹底することで、顧客や社会全体からの信頼を獲得し、持続可能なビジネスを展開することが可能となります。

偏見と公平性の課題

AIアルゴリズムは、トレーニングデータに基づいて意思決定を行うため、データに含まれる偏見がそのまま反映されることがあります。これにより、結果として不公平な判断が下されるリスクが存在します。特に、採用プロセスや金融サービスなど、人々の生活に直接影響を与える分野での偏見は重大な問題となります。企業はこの課題に対して積極的に取り組む必要があります。

偏見を除去するためには、まずトレーニングデータの多様性と質を確保することが重要です。特定の属性に偏らないデータを使用することで、公平性を高めることができます。また、データセットのバイアスを検出し修正するためのツールや技術の導入も効果的です。さらに、アルゴリズム自体の設計においても、公平性を考慮したアプローチが求められます。例えば、データの重み付けを調整することで、特定のグループに対する偏見を緩和することができます。

企業は、AIシステムの開発プロセスにおいて、倫理的な観点を組み込むことが重要です。開発チームに多様な背景を持つメンバーを含めることで、偏見のないシステムを構築する助けとなります。また、第三者機関による評価と監査を実施し、透明性を確保することも有効です。これにより、システムの公平性が客観的に評価され、必要な改善が行われます。

偏見と公平性の課題に取り組むことは、単に法令遵守やリスク管理の観点だけでなく、企業の信頼性を高めるためにも不可欠です。顧客やパートナーからの信頼を得るために、企業は常に最新の技術と倫理的なガイドラインに従う努力を続ける必要があります。

医療分野におけるAIの倫理的課題

医療分野でのAIの活用は、診断の精度向上や治療の効率化に大きく貢献しています。しかし、この技術の導入には多くの倫理的課題が伴います。患者データのプライバシー保護、意思決定の透明性、そして偏見の排除が特に重要な課題として挙げられます。これらの課題に対する対応は、医療機関と技術提供者の双方に求められます。

まず、患者データのプライバシー保護は最優先事項です。医療データは非常に機密性が高く、厳重な管理が必要です。クラウド環境でのデータ保存や共有においては、暗号化やアクセス制御の強化が必須です。また、データの匿名化技術を活用することで、個人の特定を防ぎつつデータの有用性を保つことが可能です。

次に、AIによる意思決定の透明性も重要な課題です。医療分野では、診断や治療のプロセスが患者の命に直接影響を与えるため、その過程を明確に説明できることが求められます。AIの診断結果がどのように導き出されたのか、医療従事者が理解し患者に説明できるようなシステム設計が必要です。これにより、AIに対する信頼性が向上します。

さらに、AIアルゴリズムの偏見を排除することも重要です。医療データセットに含まれる偏見が診断結果に影響を及ぼすことがあります。多様なデータを使用し、アルゴリズムの公平性を確保することが求められます。医療機関は、定期的にアルゴリズムの検証と評価を行い、必要に応じて修正を行うことで、公平で信頼性の高い医療サービスを提供することができます。

医療分野におけるAIの倫理的課題への対応は、患者の信頼を得るために不可欠です。技術の進化とともに、常に最新の情報とガイドラインに基づいた対応が求められます。

サイバーセキュリティとAI

AI技術の進化は、サイバーセキュリティ分野にも大きな影響を与えています。AIを活用することで、サイバー攻撃の予測や防御が可能になり、企業のセキュリティ対策が強化される一方で、新たなリスクも生まれています。特に、AIシステム自体がサイバー攻撃の対象となる場合があります。これにより、AIシステムの信頼性が損なわれ、重大なセキュリティ侵害が発生する可能性があります。

AIを利用したセキュリティ対策では、異常検知や侵入の早期発見が重要です。AIアルゴリズムは大量のデータを分析し、通常のパターンから外れる異常を迅速に検出します。これにより、攻撃が発生する前に対策を講じることが可能となります。しかし、AIシステムが誤検知を行った場合、誤った判断が下されるリスクもあります。誤検知を減らすためには、定期的なアルゴリズムのチューニングとデータセットの更新が必要です。

さらに、AIによるサイバー攻撃の自動化も懸念されています。攻撃者はAIを利用して高度な攻撃を自動化し、従来のセキュリティ対策では対応が難しい新たな脅威を生み出しています。このため、企業は防御策を常に見直し、最新の技術と情報に基づいて対策を強化する必要があります。例えば、AIと人間の専門家を組み合わせたハイブリッドアプローチが効果的です。これにより、AIの迅速な分析能力と人間の直感や経験を活かした対策を実現できます。

サイバーセキュリティとAIの関係は複雑であり、常に変化し続けるため、企業は柔軟かつ迅速に対応することが求められます。これにより、サイバー攻撃からの防御を強化し、ビジネスの安全性を確保することが可能となります。

日本政府と企業の取り組み

日本政府と企業は、AIとクラウドコンピューティングの倫理的課題に対して積極的に取り組んでいます。政府は、AI技術の発展と普及に伴う倫理的な問題を解決するためのガイドラインや規制を整備しています。これにより、企業は倫理的な基準を遵守しながら、AI技術を安全かつ効果的に活用することが求められています。

具体的には、日本政府は「AI基本法」や「データ活用推進基本法」などの法整備を進めており、AI技術の利用における透明性と公正性を確保するための枠組みを構築しています。これらの法規制は、企業が倫理的にAIを運用するための指針となり、違反した場合の罰則も明示されています。また、政府は企業と連携して、倫理的なAI開発のための教育プログラムやワークショップを提供しています。

企業側も、自社のAI技術の倫理的な運用に向けてさまざまな取り組みを行っています。例えば、AI倫理委員会を設置し、開発プロセスにおいて倫理的な観点からのチェックを行っています。さらに、企業は透明性を高めるために、AIシステムの動作原理や意思決定プロセスを公開し、外部の専門家による評価を受けることも増えています。これにより、顧客やパートナーからの信頼を得ることができます。

また、大手企業は政府と連携し、共同研究やプロジェクトを通じて倫理的なAIの実現を目指しています。これには、データの匿名化技術の開発や、公平性を確保するためのアルゴリズムの改善などが含まれます。さらに、国際的な倫理基準の策定にも貢献しており、グローバルな視点での対応が求められています。

日本政府と企業の取り組みは、AI技術の発展を支えるだけでなく、社会全体の信頼を築くためにも重要です。倫理的な課題に真摯に向き合い、継続的に改善を図ることで、AI技術の持続可能な発展が期待されます。

米国IT大手の対応事例

米国のIT大手企業は、AIとクラウドコンピューティングの倫理的課題に対して積極的な対応を行っています。例えば、グーグルはAI倫理ガイドラインを策定し、開発プロセスに倫理的な考慮を組み込んでいます。このガイドラインは、公平性、透明性、プライバシー保護を重視し、AIシステムの設計と運用における基準を提供します。これにより、AI技術が社会に与える影響を最小限に抑えつつ、技術革新を推進することが可能となります。

また、マイクロソフトはAI倫理委員会を設置し、社内外の専門家と連携してAIシステムの評価と監視を行っています。特に、偏見の排除と透明性の確保に重点を置き、アルゴリズムの検証を定期的に実施しています。これにより、AIシステムの信頼性を高め、ユーザーやパートナーからの信頼を得ることができます。さらに、マイクロソフトは倫理的なAI開発のための教育プログラムを提供し、社員の意識向上にも努めています。

アマゾンもAIとクラウドサービスにおける倫理的課題に対応するための取り組みを強化しています。例えば、データプライバシー保護のための高度な暗号化技術を導入し、顧客データの安全性を確保しています。また、AIシステムの透明性を確保するために、システムの動作原理や意思決定プロセスを公開しています。これにより、ユーザーはシステムの動作を理解し、安心して利用することができます。

これらの企業の取り組みは、AIとクラウドコンピューティングの倫理的課題に対する一つの模範となっています。各企業は、自社の技術が社会に与える影響を深く理解し、持続可能な発展を目指して倫理的な対応を続けています。このような取り組みは、他の企業や業界全体にとっても参考になるものです。

AIとクラウド環境における責任の所在

AIとクラウドコンピューティングの利用において、責任の所在を明確にすることは極めて重要です。特に、システムの誤作動やデータ漏洩が発生した場合、どの組織がどの程度の責任を負うのかを事前に明確にしておくことが求められます。これにより、トラブル発生時の対応が迅速かつ適切に行われ、信頼性の高いサービス提供が可能となります。

まず、クラウドサービスプロバイダーは、データの安全性とシステムの信頼性を確保する責任を負います。具体的には、データの暗号化、アクセス制御、システム監視などのセキュリティ対策を徹底し、顧客データの保護に努めることが求められます。また、AIシステムの運用においても、透明性を確保し、アルゴリズムの公正性を維持するための監査を定期的に実施することが重要です。

一方、AI技術を利用する企業もまた、その責任を認識する必要があります。AIシステムの導入と運用において、内部の倫理委員会を設置し、倫理的な観点からの評価と監視を行うことが推奨されます。これにより、偏見や不公平な判断を排除し、公正で透明なシステム運用を実現できます。さらに、AIシステムがもたらす影響を定期的に評価し、必要に応じて改善を行うことで、信頼性の高いサービスを提供することが可能となります。

また、法規制に基づくコンプライアンスも重要です。各国のデータ保護法やAI倫理規制を遵守し、国際的な基準に基づいた運用を行うことで、グローバルな信頼を築くことができます。企業はこれらの法規制を適切に理解し、対応することで、責任あるAIとクラウドの運用を確立することが求められます。

責任の所在を明確にすることは、AIとクラウド技術の安全な利用を確保するための基本的なステップです。これにより、企業は技術の信頼性を高め、顧客や社会全体からの信頼を得ることができます。

未来への展望と倫理的指針

AIとクラウドコンピューティングの技術は、今後ますます進化し、私たちの生活やビジネスに大きな影響を与えることが予想されます。しかし、その進化と共に新たな倫理的課題も生まれてきます。企業はこれらの課題に対して積極的に取り組む必要があります。倫理的指針を確立し、それに基づいた技術の開発と運用を行うことで、持続可能な技術の発展を実現することができます。

まず、技術の透明性を確保することが重要です。AIシステムやクラウドサービスの動作原理を明確にし、利用者が理解できる形で情報を提供することが求められます。これにより、利用者は技術に対する信頼を持ち、安心して利用することができます。また、企業は透明性の確保と共に、定期的な監査を実施し、システムの公平性と正確性を評価することが必要です。

次に、倫理的なガイドラインに基づいた技術開発を行うことが求められます。これは、偏見のないデータの使用や、公平なアルゴリズムの設計などが含まれます。企業は開発プロセスにおいて多様性を重視し、さまざまな視点からの評価を取り入れることで、より公正なシステムを構築することができます。さらに、外部の専門家や倫理委員会との連携を強化し、客観的な評価を受けることも有効です。

また、法規制の遵守も欠かせません。各国のデータ保護法やAI倫理規制に従い、適切なコンプライアンスを維持することで、国際的な信頼を築くことができます。企業はこれらの規制を理解し、実践することで、責任ある技術運用を確立することが求められます。特に、国際的なビジネス展開を行う企業は、グローバルな視点からの対応が重要です。

未来に向けて、AIとクラウドコンピューティングの技術が社会に与える影響を深く理解し、倫理的な課題に真摯に向き合うことが求められます。技術の進化と共に倫理的指針を常に見直し、改善を続けることで、持続可能な技術の発展を目指すことができます。

まとめ:AIとクラウドコンピューティングの倫理的課題の重要性

AIとクラウドコンピューティングの進化は、私たちの生活やビジネスに多大な恩恵をもたらしていますが、その一方で数々の倫理的課題も浮上しています。プライバシーの侵害、意思決定の透明性、公平性の欠如など、これらの課題は企業が技術を利用する際に必ず対処しなければならない重要な問題です。企業はこれらの課題に対して積極的に取り組み、透明性、公平性、責任の所在を明確にするための方策を講じる必要があります。

特に、AI倫理の確立は、技術が信頼され、持続可能に発展するための基盤となります。企業はトレーニングデータの質と多様性を確保し、偏見を排除するための技術とプロセスを導入することが求められます。また、AIシステムの意思決定プロセスを透明にし、ユーザーや社会全体がその動作を理解できるようにすることが重要です。定期的な監査と評価を通じて、システムの信頼性と公正性を維持することも不可欠です。

クラウドコンピューティングの利用においては、データの保護と管理が重要な課題となります。クラウドサービスプロバイダーと利用企業の双方が、データの暗号化、アクセス制御、セキュリティ対策を徹底し、データの安全性を確保する責任を共有することが求められます。さらに、データの所有権と責任の所在を明確にし、トラブル発生時の対応を迅速に行うための体制を整えることが重要です。

米国IT大手企業の事例からもわかるように、倫理的な対応は技術革新と信頼性の向上に直結します。企業はガイドラインの策定、倫理委員会の設置、外部評価の導入などを通じて、倫理的な技術運用を実現しています。このような取り組みは、他の企業や業界全体にとっても模範となり、持続可能な技術の発展を支える基盤となります。

日本政府と企業も、AIとクラウドコンピューティングの倫理的課題に対する取り組みを進めています。法規制の整備や教育プログラムの提供を通じて、倫理的な技術利用を促進しています。これにより、企業は法規制を遵守し、国際的な信頼を築くことができます。今後も技術の進化と共に、倫理的指針を見直し、改善を続けることで、持続可能な技術の発展が期待されます。