AI需要の爆発的拡大により、世界の半導体市場はかつてない成長局面に突入しています。とりわけ注目を集めているのが、特定用途に最適化された「AI専用ASIC」です。

AIチップ市場は2026年に1,200億ドル規模へ拡大し、AIサーバーの約3割をASICベースが占める見通しです。推論中心のワークロードへの移行が進む中、電力あたりの性能や総保有コストが企業競争力を左右する時代に入りました。

本記事では、2nmプロセスやHBM4、CXL 3.1といった最先端技術から、Microsoft・Google・AWSの自社開発チップ戦略、日本のRapidusやPFNの挑戦、さらに自動運転・医療分野での実装事例までを体系的に整理します。AI専用ASICが再定義する計算基盤の現在地と、ビジネスパーソンが押さえるべき戦略的論点をわかりやすく解説します。

AI超周期の到来:1兆ドル市場を目前にした半導体産業の構造変化

2026年、半導体産業は明確に「AI超周期」の只中にあります。世界市場規模は1兆ドル目前とされ、TSMCの企業価値評価も従来の景気循環ではなくAI需要の持続性に依存していると投資家向け分析で指摘されています。

この成長を牽引しているのは、汎用GPUの延長線上ではなく、AI専用ASICへの構造的転換です。計算性能の最大化から、用途特化による効率最適化へと競争軸が移りました。

市場データを見ると、その変化は定量的にも鮮明です。Precedence Researchによれば、世界のAIチップ市場は2024年の733億ドル規模から2026年には1,218億ドルへ拡大し、2034年には9,312億ドルに達する見通しです。

| 指標 | 2024年 | 2026年 |

|---|---|---|

| 世界AIチップ市場 | 733億ドル | 1,218億ドル |

| AIサーバー出荷増加率 | – | 前年比28%増 |

| ASICベースサーバー比率 | – | 27.8% |

TrendForceの予測では、2026年のAIサーバー出荷は前年比28%増、そしてASICベースのサーバーが27.8%を占め過去最高に達しています。依然としてGPUが主流であるものの、構造変化は不可逆的です。

なぜ今ASICなのか。その答えはAIワークロードの質的転換にあります。モデル開発の中心が「大規模学習」から、数億人規模に提供される「日常的推論」へ移行しました。

推論では汎用性よりも、電力あたりの生成トークン数、いわばReasoning-per-wattが収益性を左右します。クラウド事業者にとっては総保有コスト(TCO)の最適化が最優先課題であり、特定アルゴリズムに最適化されたシリコンが優位に立ちます。

地域構造にも変化が見られます。北米が依然として約38%の市場シェアを占める一方、日本を含むアジア太平洋地域は最速の成長率を記録しています。政府主導の半導体投資やソブリンAI戦略が、専用ハードウェア需要を押し上げています。

つまり2026年の半導体産業は、単なる景気循環的な拡大局面ではありません。アルゴリズム、電力、資本効率を中心に再設計される産業構造の転換点にあります。

1兆ドル市場はゴールではなく通過点です。カスタムシリコンが計算基盤の常識を塗り替える中で、競争優位は「より速い」企業ではなく「より効率的に価値を届けられる」企業に移りつつあります。

GPUからASICへ:推論シフトがもたらすReasoning-per-watt競争

2026年のAI半導体競争は、単なる演算性能(FLOPS)の比較から、いかに少ない電力で高度な推論を実行できるかという「Reasoning-per-watt」の勝負へと明確に軸足を移しています。

TrendForceによれば、2026年のAIサーバー出荷は前年比28%増と拡大を続ける一方、ASICベースのサーバー比率は27.8%に達しました。これは学習中心から推論中心への構造転換を象徴しています。

数億人規模のユーザーに日常的に応答する生成AIでは、電力効率がそのまま利益率を左右します。ここでGPUの汎用性よりも、特定ワークロードに最適化されたASICが優位に立ち始めています。

| 観点 | GPU中心モデル | ASIC中心モデル |

|---|---|---|

| 設計思想 | 汎用並列計算 | 特定AIアルゴリズムに最適化 |

| 主戦場 | 大規模学習 | 大規模推論 |

| 競争指標 | ピーク性能 | Reasoning-per-watt |

| TCO | 電力・冷却負荷が大 | 用途特化で電力効率向上 |

Googleが「Ironwood」を推論時代向けTPUと位置付け、推論時計算の強化を打ち出したのは象徴的です。またMicrosoftのMaia 200も、1ドルあたり性能を30%改善したと報じられています。

これらの動きの本質は、モデルそのものよりもトークン生成あたりのエネルギー消費をいかに抑えるかという経済合理性にあります。電力制約が顕在化する中、1チップあたり750W級の消費電力はデータセンター設計そのものを左右します。

ASICは不要な回路を削ぎ落とし、TransformerやMixture-of-Expertsなど特定構造に最適化することで、同一電力条件下でより多くの推論ステップを実行できます。HBM4やLogic-in-Memoryの導入も、データ移動電力の削減を通じてReasoning-per-wattを押し上げています。

推論が収益を生む時代には、電力あたりの思考量こそが競争力です。

Precedence Researchの予測では、AIチップ市場は2034年に9,000億ドル超へ拡大します。この成長の中心は学習用GPUの単純増設ではなく、推論最適化ASICの量的拡大にあります。

GPUからASICへのシフトは、性能競争の終焉ではありません。むしろ競争軸が「どれだけ速いか」から「どれだけ賢く、どれだけ省電力で考えられるか」へと進化した結果です。2026年は、その転換点として記憶される年になりつつあります。

市場データで読むAIチップの成長軌道と地域別動向

2026年、AI専用ASIC市場は明確な成長軌道に乗っています。世界のAIチップセット市場は2024年の733億ドルから、2026年には1,218億9,000万ドルへ拡大し、2034年には9,312億6,000万ドル規模に到達する見通しです。Precedence Researchによれば、年平均成長率は約28.9%に達し、半導体市場全体の中でも突出した伸びを示しています。

特に注目すべきは、数量ベースでも構造転換が進んでいる点です。TrendForceの分析では、2026年のAIサーバー出荷台数は前年比28%増と予測され、そのうちASICベースのシステム比率は27.8%と過去最高を記録しています。GPUが依然69.7%と主流を占める一方で、推論特化型ワークロードの拡大がASIC需要を押し上げていることが読み取れます。

| 指標 | 2024年 | 2026年 |

|---|---|---|

| 世界AIチップ市場規模 | 733.2億ドル | 1,218.9億ドル |

| AIサーバー出荷成長率 | – | 前年比28% |

| ASICサーバー比率 | – | 27.8% |

地域別に見ると、北米が市場の約38%を占め、依然として最大市場です。Microsoft、Google、AWS、Metaといったハイパースケーラーが自社設計ASICを本格投入しており、クラウド需要が市場を牽引しています。S&P Global Ratingsも指摘するように、AI投資のリスクとリターンは主に北米ビッグテックの資本戦略に強く依存しています。

一方で、最も高い成長率を示しているのがアジア太平洋地域です。日本政府は2030年度までに10兆円超の公的支援を打ち出し、「ソブリンAI」基盤の構築を推進しています。Rapidusの2nm量産計画や国内データセンター投資の拡大により、国家戦略と市場成長が連動する構図が形成されつつあります。

また、中国や韓国を含む東アジアでは、HBM需要の急増がメモリ主導型の成長を生み出しています。SKハイニックスは2026年を「HBM主導のメモリスーパーサイクル」と位置付けており、AI向け高帯域メモリの供給が地域経済に与える影響は極めて大きいです。

このように2026年のAIチップ市場は、単なる規模拡大ではなく、北米の設計主導モデルとAPACの製造・国家主導モデルという二極構造へと進化しています。市場データは、AI専用ASICがグローバル競争の中心的インフラへと格上げされたことを明確に示しています。

2nm(GAA)時代の幕開け:性能15%向上と電力30%削減の衝撃

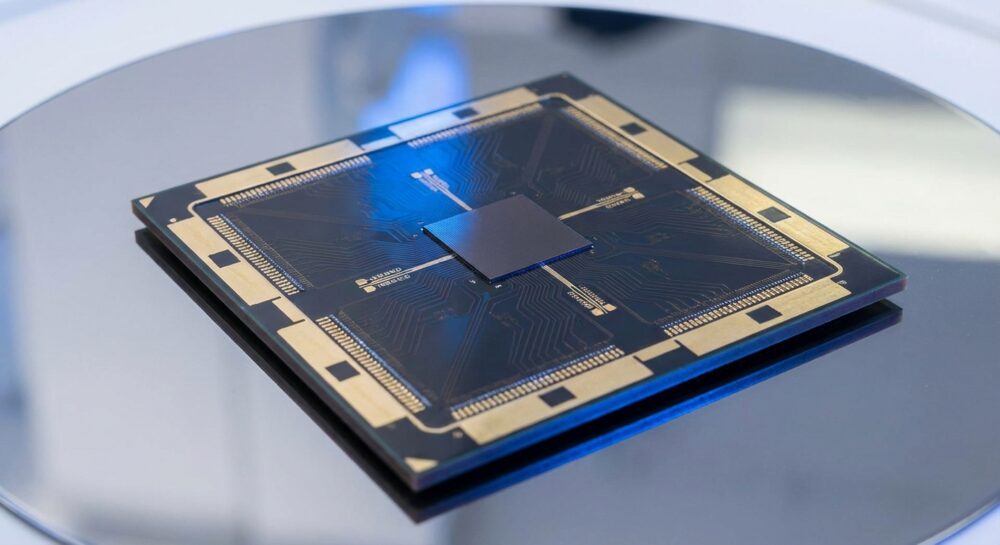

2026年、先端ロジックはついに2ナノメートル(2nm)世代へと突入しました。最大の転換点は、従来のFinFETからGate-All-Around(GAA)トランジスタへの全面移行です。

TSMCやサムスン電子が量産を進めるこの新世代は、AI専用ASICの電力効率を根本から塗り替えつつあります。微細化の延長ではなく、構造そのものの進化が主役になっています。

| 比較項目 | 3nm世代(2024年) | 2nm世代(2026年) |

|---|---|---|

| トランジスタ構造 | FinFET | GAA |

| 性能(同一電力) | 基準 | 10〜15%向上 |

| 消費電力(同一性能) | 基準 | 25〜30%削減 |

| ウェハー価格 | ― | 3万ドル超 |

技術検証データによれば、2nmプロセスは同一電力条件下で最大15%の性能向上同一性能で最大30%の消費電力削減を実現しています。これは単なる数値改善ではありません。データセンターにおける「1ワットあたりの推論性能」を直接押し上げる、経済合理性そのものの進化です。

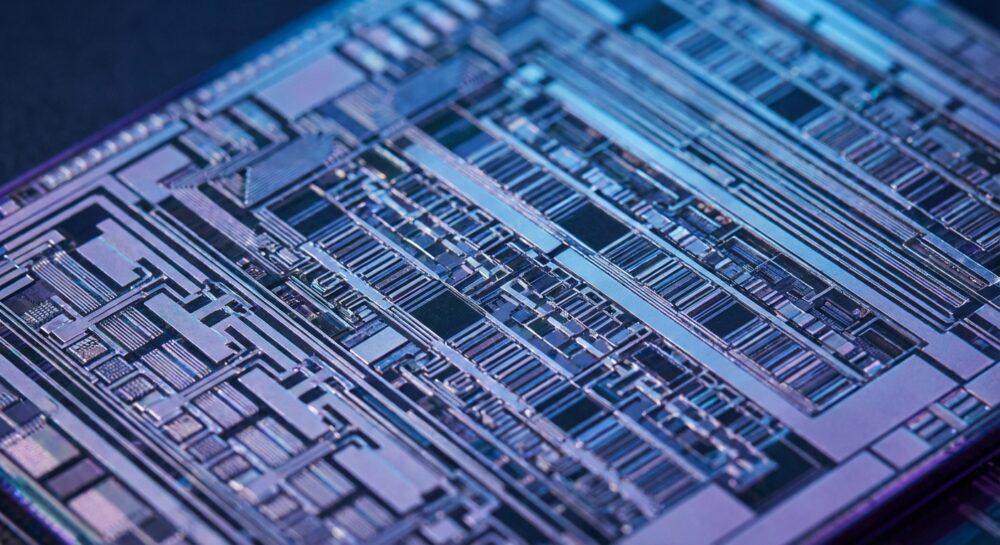

GAA構造では、チャネルをゲートが全周囲から包み込むため、リーク電流が大幅に抑制されます。微細化で深刻化していた電流制御の難題に対し、物理構造で応えた形です。

さらに注目すべきは、バックサイド・パワー・デリバリー(BSPD)の導入です。電力配線をチップ裏面に移すことで、表面の配線混雑を解消し、電力供給効率と信号品質を同時に改善しています。これにより、高密度ロジックでも安定した動作が可能になりました。

一方で、2nmウェハーの価格は1枚あたり3万ドルを超える水準に達しています。S&P Globalなどが指摘するように、先端ノードへの投資は一部の巨大資本に集中し、計算資源の格差を拡大させる要因にもなっています。

それでもAI専用ASICが2nmへ急速に移行している理由は明確です。電力がボトルネックとなる時代において、30%の電力削減は、そのままサーバー密度の向上とTCO改善に直結するからです。2nm(GAA)は、AI計算の競争軸を「スケール」から「効率」へと移す、象徴的な転換点になっています。

HBM4とLogic-in-Memory:メモリー・ウォール突破の最前線

AI専用ASICの進化を語る上で避けて通れないのが、長年ボトルネックとされてきた「メモリー・ウォール」の突破です。2026年、この課題に対する解がHBM4とLogic-in-Memoryという二つの技術軸で具体化しました。

AIモデルの巨大化により、演算性能そのものよりも「データをいかに速く、効率的に供給できるか」が競争力を左右しています。Stanford大学の研究報告やHPCwireの分析でも、データ移動の電力コストがAI全体の支配的要因になりつつあると指摘されています。

2026年の本質は「計算を速くする」から「データ移動を減らす」への転換です。

まずHBM4は、インターフェース幅を2,048ビットへ拡張し、帯域幅は毎秒2TBを超えます。SKハイニックスの市場見通しによれば、HBM主導のメモリスーパーサイクルが形成されており、AIサーバー向け需要が急増しています。

| 項目 | HBM3E(主流) | HBM4(2026先端) |

|---|---|---|

| インターフェース幅 | 1,024bit | 2,048bit |

| 帯域幅 | 数TB/s級 | 2TB/s超 |

| 設計特徴 | 高帯域3D積層 | Logic-in-Memory対応 |

しかし真に革新的なのは、HBM4世代で本格化したLogic-in-Memoryです。メモリスタックのベースダイに先端ロジックを組み込み、メモリ内部で前処理や簡易AI演算を実行します。これにより、プロセッサとの往復データ転送を大幅に削減できます。

報道ベースでは、データ移動に伴う電力を最大90%削減できる可能性が示されており、推論レイテンシの短縮にも直結します。特に大規模言語モデルの推論では、トークン生成あたりのエネルギー効率が収益性を左右するため、この改善は戦略的意味を持ちます。

さらに、CXL 3.1の普及がこの動きを後押ししています。Compute Express Linkコンソーシアムや業界分析によれば、サーバー間でのメモリ・プーリングが200〜500ナノ秒級で実現し、断片化されたメモリ資源を統合可能になりました。

チップ内ではLogic-in-Memoryで移動を減らし、データセンター全体ではCXLで共有するという二層構造が、2026年の新しいアーキテクチャ標準になりつつあります。

結果として、AI専用ASICは単なる演算アクセラレータから「メモリ統合型コンピューティング基盤」へと進化しました。HBM4とLogic-in-Memoryは、物理的限界とされたメモリー・ウォールを、三次元統合とアーキテクチャ革新で突破する象徴的な存在になっています。

CXL 3.1が実現するメモリ・プーリングとデータセンター再設計

AI専用ASICの性能が飛躍的に高まる一方で、2026年のデータセンターが直面している最大の課題は「メモリの分断」です。CPUやGPU、ASICごとにメモリが固定的に紐づく従来構成では、ワークロードの変動に応じた柔軟な再配分ができず、リソースの断片化が常態化していました。

この構造的課題を解決する鍵が、CXL 3.1によるメモリ・プーリングです。CXLはPCIe 6.2の物理層を活用し、サーバー間でメモリを共有可能にするインターコネクト規格であり、2026年には本格的な商用導入が進んでいます。

CXL 3.1は「メモリをサーバーの所有物からデータセンター全体の共有資源へと変える」転換点です。

| 項目 | 従来構成 | CXL 3.1導入後 |

|---|---|---|

| メモリ管理 | サーバー単位で固定 | ラック/クラスタ単位で共有 |

| レイテンシ | NVMe経由でミリ秒級 | 約200〜500ナノ秒 |

| 利用効率 | 未使用領域が発生 | 最大50%改善 |

Compute Express Link Consortiumや関連ベンダーの技術解説によれば、CXL 3.1ではテラバイト級のメモリを単一プールとして束ね、AI推論や大規模データ処理に応じて動的に割り当てることが可能になります。これにより、急増する推論ワークロードに対し、ハードウェア増設ではなく「再構成」で対応できるようになります。

特に生成AIの推論では、モデルサイズや同時接続ユーザー数の変動が激しく、ピーク時に合わせた過剰プロビジョニングがTCOを押し上げてきました。CXL 3.1環境では、夜間バッチ処理用に確保していたメモリを昼間のリアルタイム推論へ再割当てするなど、データセンター全体を“流動化”できます。

レイテンシの観点でも進化は顕著です。従来、ストレージ経由でのデータ移動はミリ秒単位でしたが、CXL接続では200〜500ナノ秒と、プロセッサ直結に近い速度でアクセス可能とされています。これは大規模言語モデルのコンテキスト拡張やインメモリ分析の実用性を大きく押し上げます。

結果として、メモリ利用効率は最大50%向上し、電力あたりの有効計算量も改善します。これはAIサーバー出荷が前年比28%増と拡大する中で、電力制約に直面するデータセンターにとって極めて重要な意味を持ちます。

CXL 3.1の普及は、サーバーという単位を前提に設計されてきた従来型アーキテクチャを再定義しつつあります。今後の競争力は、単一ASICの性能ではなく、メモリと計算資源をいかに柔軟に編成できるかという「構成力」によって左右される時代に入っています。

ハイパースケーラーの垂直統合戦略:Maia 200・Ironwood・Trainium 3の実力

2026年、ハイパースケーラー各社はGPU依存から脱却し、自社設計ASICを中核に据えた垂直統合モデルへと本格的に舵を切っています。背景にあるのは、AIサーバー出荷のうちASICベースが27.8%に達したというTrendForceのデータが示す構造変化です。推論中心の時代においては、汎用性よりもワークロード特化による効率最大化が競争力を左右します。

Maia 200、Ironwood、Trainium 3はいずれも「自社ソフトウェアに最適化されたシリコン」という共通思想を持ちながら、性能・経済性・スケール設計で明確に差別化されています。

| 項目 | Maia 200 | Ironwood | Trainium 3 |

|---|---|---|---|

| プロセス | 3nm(N3P) | 非公開 | 3nm(N3P) |

| メモリ帯域 | 7.0TB/s | 7.37TB/s | 4.9TB/s |

| 最大構成 | 単体最適化 | 9,216チップ接続 | 144チップ統合 |

| 主眼 | 推論効率 | 大規模推論 | コスト最適化 |

MicrosoftのMaia 200は、1,400億トランジスタと216GBのHBM3eを搭載し、最大7TB/sの帯域を確保しています。Tom’s Hardwareなどの報道によれば、同社は1ドルあたり性能を30%向上させたと主張しています。Azure制御プレーンと深く統合され、OpenAIの大規模モデル運用を支える設計は、クラウドからアプリケーションまで一気通貫で最適化する典型例です。

Googleの第7世代TPU「Ironwood」は、9,216チップを単一ドメインで束ね42.5EFLOPS級に拡張可能な点が特徴です。チップあたり7.37TB/sの帯域と改良型SparseCoreにより、推論時計算や複雑なReasoning処理を高速化しています。さらにDeepMindのAlphaChipによるレイアウト最適化は、「AIがAIを設計する」垂直統合の象徴です。

AWSのTrainium 3は、性能等価を掲げつつコスト半減を前面に打ち出しています。報道では主要顧客がトレーニングコストを最大50%削減したとされ、Neon SDKを通じたPyTorch互換環境が導入障壁を下げています。電力効率も前世代比40%改善され、電力制約が厳しいデータセンター環境で優位に立ちます。

3社の戦略を俯瞰すると、Microsoftは推論収益性、Googleは超大規模スケール、AWSはコスト効率という異なる軸で最適解を提示しています。ハイパースケーラーのASICはもはや代替GPUではなく、クラウドビジネスモデルそのものを再定義する基盤へと進化しています。

GPUとの比較で見るASICの優位性と限界

AI計算の主役がGPUからASICへと広がる中で、両者の違いは「性能」そのものよりも設計思想と経済合理性にあります。GPUは本来グラフィックスや並列演算向けに設計された汎用アクセラレータであり、多様なワークロードに柔軟に対応できることが強みです。一方、ASICは特定のAIモデルや用途に合わせて回路レベルから最適化されており、無駄を極限まで削ぎ落とすアプローチを取ります。

2026年時点でもGPUベースのAIサーバーは69.7%のシェアを持ち主流です。しかしTrendForceによれば、ASICベースは27.8%まで拡大し過去最高を更新しています。この差は単なる置き換えではなく、用途の分化を意味しています。

| 観点 | GPU | AI専用ASIC |

|---|---|---|

| 設計思想 | 汎用並列計算 | 特定AI処理に特化 |

| 強み | 柔軟性・エコシステム | 電力効率・TCO最適化 |

| 主戦場 | 大規模学習 | 大規模推論 |

| 課題 | 消費電力増大 | 用途限定・初期投資 |

ASICの最大の優位性は、Reasoning-per-watt、すなわち電力あたりの推論性能にあります。推論がAIビジネスの収益源となった現在、1ワットあたりどれだけ多くのトークンを生成できるかが直接的に利益率を左右します。MicrosoftのMaia 200は1ドルあたりの性能を約30%向上させたとされ、AWSのTrainium 3もGPU比で最大50%のトレーニングコスト削減を報告しています。これは単なる技術優位ではなく、クラウド事業の粗利構造そのものを変えるインパクトです。

また、電力面でも差は顕著です。最新GPUはTDPが1,400W級に達する一方、推論特化ASICは750W級で高密度運用を可能にしています。データセンターの電力制約が深刻化する中、ラック単位の計算密度を高められることは設備投資効率に直結します。

しかし、ASICには明確な限界もあります。第一に柔軟性の欠如です。アルゴリズムが大きく変化した場合、ハードウェアが陳腐化するリスクがあります。第二に製造コストです。2nm世代ではウェハー価格が約30,000ドルに達し、設計から量産まで巨額の資本が必要です。S&P Global Ratingsも指摘するように、計算資源は巨大資本を持つ企業へ集中する傾向が強まっています。

結局のところ、GPUとASICは対立関係ではなく補完関係にあります。探索的な大規模学習や新モデルの実験ではGPUの柔軟性が活き、確立したモデルの大量推論ではASICが圧倒的な経済性を発揮します。2026年の競争軸は、どちらが優れているかではなく、どのワークロードにどのシリコンを割り当てるかという戦略設計へと移行しています。

日本のソブリンAI戦略:Rapidusの2nm量産と国産設計基盤

2026年、日本のAI戦略は「性能競争」から「主権の確立」へと明確に軸足を移しています。その中核にあるのが、Rapidusによる2nm量産体制の構築と、国産設計基盤の整備です。単に先端ノードを国内で製造するという話ではなく、設計から製造、パッケージングまでを国内主導で完結できる体制を築けるかが問われています。

経済産業省の「AI・半導体産業基盤強化フレーム」によれば、2030年度までに10兆円超の公的支援が計画されています。背景には、AIチップ市場が2026年に1,218億ドル規模へ拡大するとの予測があり、先端ノードの確保が経済安全保障そのものに直結するという認識があります。

| 項目 | 2026年時点 | 戦略的意義 |

|---|---|---|

| プロセス技術 | 2nm(GAA)試作完了 | 先端ロジックの国内回帰 |

| 量産目標 | 2027年開始予定 | AI ASICの国内供給基盤 |

| 設計支援 | AI設計ツール提供開始 | 設計コスト最大30%削減 |

RapidusはIBMやimecと連携し、EUVを活用した2nm GAAトランジスタの動作実証を完了しました。業界報道によれば、2nm世代では同一性能で消費電力を25〜30%削減できる可能性が示されており、AI推論用途では電力効率が直接競争力に直結します。

注目すべきは、Rapidusが掲げるRUMS構想です。これは設計・製造・先端パッケージングを一体化するモデルで、従来の「分断されたサプライチェーン」からの脱却を目指します。国内企業が特定用途向けAI ASICを短期間で試作・量産できる環境を整えることが最大の狙いです。

さらに2026年からはAIエージェントを活用した設計ツール群の提供も始まりました。設計工程の自動化によりコストを最大30%削減する取り組みは、2nmウェハー価格が3万ドル規模に達する中で極めて重要です。製造コストの高騰が続く状況下では、設計効率の改善が事業成立の分水嶺になります。

ソブリンAIの本質は「GPUを買うこと」ではありません。日本語LLMや産業特化型モデルを、国内法制とデータ主権の枠内で動かせる半導体基盤を持つことです。先端ロジックを国外依存のままでは、輸出規制や地政学リスクに戦略が左右されます。

2026年は、Rapidusが単なる象徴から実装段階へと進む転換点です。2nm量産と国産設計基盤の確立は、日本がAI超周期の中で「利用者」から「基盤提供者」へと立場を変えられるかを占う試金石になっています。

PFN MN-Coreと3Dスタック革命:エネルギー効率で挑む日本勢

日本発AI半導体の中核として注目を集めているのが、Preferred Networks(PFN)の「MN-Core」シリーズです。とりわけ2026年時点で開発が進む生成AI推論向けプロセッサ「MN-Core L1000」は、電力効率を軸にした設計思想で世界市場に挑んでいます。

PFNは単にGPU代替を目指しているのではありません。大規模推論をいかに少ない電力で、安定的に回し続けられるかという観点から、アーキテクチャそのものを再設計しています。

MN-Core L1000のアーキテクチャ的特徴

| 項目 | 特徴 | 狙い |

|---|---|---|

| メモリ構造 | ロジック上にDRAMを3D積層 | 超広帯域・低レイテンシ化 |

| コスト設計 | HBMではなく汎用DRAM活用 | 性能と価格の両立 |

| ターゲット | 生成AI推論 | 大規模モデルの単一ノード処理 |

最大の革新は、ロジックウェハー上に大容量DRAMを垂直方向に積層する3Dスタック構造です。Stanford Reportなどが指摘するように、AI計算の最大の制約は「メモリー・ウォール」にありますが、PFNはこの壁を物理的距離の短縮で突破しようとしています。

従来のGPU+HBM構成では、帯域は広いもののコストと消費電力が課題でした。L1000は汎用DRAMを直接垂直接続することで、HBM級の帯域を確保しながら価格を抑制するというアプローチを取っています。

この思想は、PFNが構築してきたスーパーコンピュータ「MN-3」にも通じます。MN-3はGreen500で複数回世界1位を獲得しており、電力あたり性能で世界最高水準を示してきました。これは単なるベンチマーク上の成果ではなく、日本型AIインフラの方向性を示す象徴的な実績です。

さらに2026年には、さくらインターネットやRapidusとの連携を通じて、省電力な純国産AI基盤の社会実装が加速しています。設計から製造、データセンター実装までを国内エコシステムで完結させる構想は、経済安全保障の観点からも重要です。

世界のハイパースケーラーが巨大電力を前提にASICを進化させる中、PFNはエネルギー制約を前提条件とする設計思想で差別化しています。電力がボトルネックとなる2020年代後半において、このアプローチは単なる技術的挑戦ではなく、持続可能なAI競争力の核心となり得ます。

AI-RANとソブリン・クラウド:国内インフラの再構築

AI-RANとソブリン・クラウドは、単なる通信高度化やクラウド多様化の話ではありません。国内インフラそのものを「AI前提」で再設計する動きとして、2026年に本格化しています。

ソフトバンクが推進するAI-RANは、全国の基地局を分散型AI計算基盤として再活用する構想です。従来はトラフィックをクラウドへ集約して処理していましたが、エッジ側にASICやGPUを配置することで、数十ミリ秒単位の超低遅延処理を実現します。

SoftBank Research Institute of Advanced Technologyによれば、AI-RANは通信最適化だけでなく、生成AIや映像解析などの推論処理を基地局近傍で実行することを前提としています。これにより、帯域負荷とクラウド転送コストの削減も同時に達成します。

| 項目 | 従来型クラウド集中処理 | AI-RAN型分散処理 |

|---|---|---|

| 処理場所 | 中央データセンター | 基地局エッジ |

| レイテンシ | 数百ms規模 | 数十ms規模 |

| 回線負荷 | 高い | 低減可能 |

| 主用途 | 大規模学習・汎用推論 | リアルタイム推論・ローカルAI |

このアーキテクチャは、自動運転支援、スマートシティ監視、産業IoTなど「即時性」が価値を生む領域で特に威力を発揮します。AI専用ASICの電力効率向上がなければ成立しなかった設計思想です。

一方で、ソブリン・クラウドは「データ主権」を軸に再構築されています。ソフトバンクはOracle Alloyを活用し、日本国内データセンター内で運用管理を完結させる体制を構築しました。Light Readingなどの報道によれば、これは公共機関や規制産業向けに設計された主権確保型クラウドです。

重要なのは、ハードウェア主導でクラウドの性格が変わりつつある点です。NVIDIA Blackwell世代GPUとカスタムASICを組み合わせたAI基盤を国内で運用することで、計算資源の国外依存リスクを緩和します。

さらに、700億パラメータ級の日本語特化モデルの商用展開が進む中、データ保存場所・推論実行場所・運用主体を国内に閉じる設計は、EU AI Actのような国際規制への対応力も高めます。

結果として、通信インフラ、データセンター、AI専用ASICが一体化した「国家レベルの計算基盤」が形成されつつあります。これはクラウド戦略ではなく、デジタル主権を前提としたインフラ再設計という新しい段階に入ったことを意味しています。

自動運転と医療診断:ドメイン特化型ASICが社会実装を加速

自動運転と医療診断は、ドメイン特化型ASICが最も実装効果を発揮している領域です。クラウド中心だったAIは、2026年には車両や医療機器といった“現場”でリアルタイムに推論する段階へ進みました。

背景にあるのは、遅延・消費電力・安全性という3つの制約を同時に満たす必要性です。汎用GPUでは過剰または非効率だった処理を、用途特化シリコンが最適解として置き換えています。

自動運転:セントラル集約型アーキテクチャへの転換

ルネサスの第5世代車載SoC「R-Car X5H」は3nmプロセスを採用し、単体で400TOPSのAI性能を実現しています。ADAS、インフォテインメント、ゲートウェイを1チップで統合し、従来比35%の低消費電力化を達成したと報じられています。

一方、NVIDIAのDRIVE Thorは最大2,000TOPSに達し、生成AIベースのVLMやVLAモデルを車載で動作させる設計です。中国や欧州の自動車メーカーが採用を進め、ソフトウェア・ディファインド・ビークルの中核を担っています。

| 項目 | R-Car X5H | NVIDIA Thor |

|---|---|---|

| プロセス | 3nm | 非公開 |

| AI性能 | 400TOPS | 最大2,000TOPS |

| 特徴 | マルチドメイン統合・低消費電力 | 生成AI対応・高演算密度 |

重要なのはピーク性能ではなく、車載という厳しい熱設計枠内で安定稼働できる専用設計です。チップレット拡張や機能安全規格への対応を前提とした設計思想が、量産車への実装を加速させています。

医療診断:リアルタイム推論が標準へ

医療分野では、MedtronicのGI Geniusが代表例です。数百万の内視鏡フレームで学習したAIを専用ハードウェア上で動作させ、大腸ポリープの見逃し率を最大50%削減したと同社は公表しています。

画像診断領域でも、AIは胸部X線やMRI解析で94%の精度を示すケースが報告されており、特に脳出血など緊急症例のスクリーニングで高速推論が救命率向上に寄与しています。専用ASICにより、クラウド依存を減らし院内で即時処理できる点が評価されています。

さらに、診察中の会話を自動で構造化ノートに変換するアンビエントAIスクライブは、医師の事務作業を約30%削減したとされます。ここでも重要なのは、常時稼働し続ける低遅延・低消費電力の推論基盤です。

自動運転も医療も、人命に直結する領域です。だからこそ、用途に最適化されたドメイン特化型ASICが、安全性・効率性・説明可能性を同時に満たす基盤として社会実装を加速させています。

電力制約と環境負荷:AI時代のパワー・ウォール問題

AI専用ASICの進化は、性能競争を新たな次元へ押し上げましたが、その裏側で顕在化しているのが電力制約、いわゆる「パワー・ウォール」です。2026年時点では、単一チップで750Wから1,400W級の電力を消費する製品が登場し、データセンターの設計思想そのものを揺さぶっています。

かつては演算性能がボトルネックでしたが、現在は「電力をどこまで供給できるか」が成長の上限を決める時代に入りました。ラックあたりの電力密度は急上昇し、冷却や受電設備の増強が追いつかないケースも報告されています。

| 項目 | 2024年水準 | 2026年水準 |

|---|---|---|

| 先端AIチップTDP | 数百W規模 | 750W〜1,400W |

| AIサーバー出荷増加率 | – | 前年比約28%増 |

| ASICサーバー比率 | – | 27.8% |

TrendForceによれば、AIサーバー出荷は2026年に前年比28%増と予測されており、電力需要も比例して拡大しています。問題は、この需要増が必ずしも再生可能エネルギーの拡大と歩調を合わせていない点です。

The Guardianの報道では、AI向け電力需要の急増により、停止予定だった化石燃料発電所の稼働延長が議論されていると指摘されています。つまりAIの成長がクリーンエネルギー移行を逆行させるリスクが現実味を帯びているのです。

特に深刻なのは、環境負荷の「不可視性」です。調査によれば、AI戦略を持つ企業の97%が電力使用量や炭素排出量を正確に把握できていないとされています。これはESG開示やサプライチェーン規制が強化される中で、重大なガバナンス課題となります。

一方で、対策も進み始めています。液冷サーバーや高効率電源設計に加え、Googleが電力網制御企業を買収し、需給最適化にAIを活用する動きも報じられました。消費側だけでなく、供給側の知能化が始まっているのです。

しかし本質的な問いは残ります。AIの価値創出と地球環境の持続可能性をどう両立させるのか。Reasoning-per-wattの競争は単なる効率指標ではなく、企業の社会的信頼を左右する経営指標へと変わりつつあります。電力を制する者がAI時代を制する――その意味は、もはや技術だけの問題ではありません。

コスト高騰と計算資源の格差:民主化は進むのか

AI専用ASICの進化は、性能面では飛躍的な成果を上げていますが、その裏側で深刻化しているのがコスト高騰と計算資源の格差です。とりわけ2nmや3nmといった先端プロセスへの移行は、技術的ブレークスルーであると同時に、参入障壁を歴史的水準まで引き上げています。

報道や業界分析によれば、2nmウェハー1枚の製造コストは約30,000ドルに達しています。これは数年前の世代と比べても大幅な上昇であり、設計費用やマスク費用、先端パッケージング(CoWoS-Rや3D IC)まで含めると、最先端ASICの開発には数億ドル規模の投資が必要になるケースも珍しくありません。

| 項目 | 2024年前後 | 2026年 |

|---|---|---|

| 先端ノード | 4nm / 5nm | 2nm / 3nm |

| ウェハー価格 | 非公開(推定上昇傾向) | 約30,000ドル |

| 主なプレイヤー | GPU中心 | ハイパースケーラー内製ASIC拡大 |

この結果、巨大資本を持つハイパースケーラーと、それ以外の企業・研究機関との間で「計算資源の非対称性」が急拡大しています。TrendForceの予測では、AIサーバー出荷は前年比28%増と拡大する一方、ASICベースの比率は27.8%に達し、特定企業による垂直統合が加速しています。

MicrosoftのMaia 200やGoogleのIronwood、AWSのTrainium 3といった内製チップは、性能あたりコストや電力効率で優位性を打ち出しています。しかしそれは同時に、「自社クラウド上でのみ最大効率を発揮する設計」であることも意味します。計算基盤そのものがプラットフォームに組み込まれ、API経由でしか利用できない状況は、事実上の中央集権化を進めかねません。

S&P Global Ratingsも、AI投資リスクの一つとして資本集約化とリターン偏在を指摘しています。最先端計算資源へのアクセス可否が、研究開発力や新規参入機会を左右する構造は、長期的にはイノベーションの多様性を損なう可能性があります。

一方で、完全な悲観論だけではありません。CXL 3.1によるメモリ・プーリングや、チップレットによる異種ノード統合は、先端ロジックを最小限に抑えつつ高性能を実現する道を開いています。また、日本のように公的支援で設計ツールや製造基盤を整備する動きも、アクセス格差を緩和する試みの一つです。

今後の焦点は、性能競争そのものよりも「誰が計算能力をコントロールするのか」というガバナンスの問題へと移行しています。AI専用ASICは技術革新の象徴であると同時に、デジタル経済における新たな格差構造を映し出す鏡でもあります。

機密コンピューティングと規制対応:信頼されるAI基盤へ

AI専用ASICが社会インフラへと組み込まれる2026年において、競争力の源泉は性能や電力効率だけではありません。機密コンピューティングと規制対応を前提とした設計思想こそが、信頼されるAI基盤の必須条件になっています。

特に医療、金融、公共分野では、データ主権と説明責任を満たさなければ市場参入そのものが困難です。EU AI Actをはじめとする各国規制は、高リスク用途のAIに対し厳格なガバナンスを求めています。

この流れを受け、2026年の先端ASICではハードウェアレベルでの保護機構が標準装備となりつつあります。

| 要素 | 2026年の動向 | ビジネス上の意味 |

|---|---|---|

| 機密コンピューティング | プロセッサ内の安全な隔離領域で推論実行 | クラウド事業者からもデータを秘匿 |

| 説明可能性補助回路 | 高リスク用途向けに搭載議論 | 規制対応コストの低減 |

| ソブリン対応 | 国内完結型クラウド基盤の整備 | 公共・金融案件の獲得 |

機密コンピューティングは、データを「保存時」「通信時」だけでなく「処理中」も暗号化・隔離するアプローチです。NVIDIAが次世代プラットフォームで強調するように、AIワークロードそのものを安全な実行環境に閉じ込める設計が進んでいます。

これにより、クラウドプロバイダーの管理者であっても顧客データへアクセスできない構造が実現します。医療画像や金融トランザクションの推論処理において、この特性は導入可否を左右する決定打になります。

さらにEU AI Actでは、高リスクAIに対し透明性やトレーサビリティが求められています。医療AIや自動運転向けASICでは、推論ログの安全な保存や検証可能性を支えるハードウェア支援機能の重要性が高まっています。

日本市場でも、ソフトバンクのOracle Alloy活用による国内完結型ソブリンAIクラウドや、政府のAI・半導体産業基盤強化フレームが象徴するように、規制適合とデータ主権は国家戦略レベルのテーマになっています。

単に高速な推論を実現するだけでは不十分です。規制を前提に設計されたシリコンこそが、公共調達や医療機関、金融機関との長期契約を可能にします。

2026年のAI専用ASIC市場において、機密性・説明可能性・主権対応を組み込んだ基盤だけが、持続可能で社会的に受容されるAIエコシステムを構築できる段階に入っています。

今後の展望:エネルギー効率・チップレット・エッジ特化が鍵を握る

2026年以降のAI専用ASICの進化を左右するキーワードは、エネルギー効率、チップレット、そしてエッジ特化の三つです。性能競争は依然として続きますが、**電力・コスト・設置場所という物理的制約をどう突破するか**が、真の競争軸へと移りつつあります。

エネルギー効率が収益性を決める時代

NVIDIAの次世代GPUやハイパースケーラー向けASICが750W〜1,400W級に達するなか、データセンターの電力供給そのものがボトルネックになっています。The Guardianの報道が指摘するように、AI需要の急増は電力網と気候政策に直接的な影響を及ぼしています。

さらにManufacturing.netによれば、AI戦略を持つ企業の97%が自社AIの環境負荷を正確に測定できていないとされています。この状況では、**Reasoning-per-wattやトークン/ワットといった指標を中心に据えた設計が不可欠**になります。

電力効率は単なるESG要件ではなく、ラック密度、冷却コスト、立地制約を含むTCO全体を左右する経営指標へと進化しています。

チップレットが「特権化」を緩和する

2nmウェハーが3万ドル規模に達するなか、全機能を最先端ノードで統合するモノリシック設計は経済的に持続しにくくなっています。そこで重要になるのがチップレット技術です。

| 設計手法 | 特徴 | 戦略的意義 |

|---|---|---|

| モノリシック | 単一ダイに全機能統合 | 高性能だがコスト集中 |

| チップレット | 異種ノードを分割統合 | コスト最適化と柔軟設計 |

最新ロジックのみを2nmで製造し、I/Oやアナログ回路、メモリ制御部を成熟ノードで構成することで、性能と価格のバランスを最適化できます。CoWoS-Rや3D ICといった先端パッケージ技術の進展は、この分割統治型アーキテクチャを現実的な選択肢にしています。

結果として、従来は巨大資本に限られていたカスタムASIC開発が、用途限定型であれば中堅企業にも広がる可能性が出てきます。

エッジ特化が新たな主戦場に

今後の最大の成長余地は、クラウドではなくエッジです。ルネサスのR-Car X5Hのような車載SoCや、医療機器内蔵ASICは、数十ミリ秒単位のレイテンシ削減と電力効率向上を同時に実現しています。

エッジ環境では、消費電力、発熱、物理サイズ、リアルタイム性がすべて制約条件になります。そのため、汎用GPUの縮小版ではなく、**用途ごとに演算パスを固定化したドメイン特化型ASIC**が主流になります。

今後は「どれだけ大規模モデルを回せるか」ではなく、「どれだけ現場で完結できるか」が競争軸になります。通信帯域の節約、データ主権の確保、セキュリティ強化という観点からも、エッジ特化型設計は国家戦略レベルの重要性を帯びています。

エネルギー効率で持続可能性を確保し、チップレットで経済合理性を高め、エッジ特化で社会実装を拡大する。この三位一体の進化こそが、2026年以降のAI専用ASIC市場の成長曲線を決定づけます。

参考文献

- Precedence Research:Artificial Intelligence (AI) Chipsets Market Size to Hit USD 931.26 Billion by 2034

- TrendForce:Global AI Server Shipments Forecast to Grow Over 28% YoY

- SK hynix Newsroom:2026 Market Outlook – Focus on the HBM-Led Memory Supercycle

- GeekWire:Microsoft unveils Maia 200 AI chip, claiming performance edge over Amazon and Google

- Google Cloud Blog:Ironwood TPUs and new Axion-based VMs for your AI workloads

- byteiota:AWS Trainium3 Matches NVIDIA: 50% Cheaper AI Training

- 経済産業省:AI・半導体産業基盤強化フレーム

- R&D World:Renesas starts sampling 3nm R-Car X5H Gen 5 automotive SoC

- Medtronic:6 healthcare tech trends for 2026

- The Guardian:‘Just an unbelievable amount of pollution’: how big a threat is AI to the climate?